获得最佳阅读体验,可点击 我的飞书文档。

一、什么是API?

API的全称是”Application Programming Interface”,中文可以翻译为”应用程序编程接口”。

调用API的密钥,我们称之为key

有了key,就可以在任何地方调用openai的服务

二、和官方的区别?

在官方,你有一个key,形如sk-xxxxxxxxx,以及请求地址:https://api.openai.com/

在我这里,你有一个key,形如sk-xxxxxxxxx,以及请求地址:

- 主站线路,跑批量推荐 请勿批量分析图片 https://api.vveai.com

- 香港线路,跑批量推荐 请勿批量分析图片 https://api.gpt.ge

三、支持哪些模型、和官方的区别?

常用的一些模型gpt-3.5turbo、gpt-4o、gpt-4、gpt-4-turbo,claude-3-5-sonnet-20241022、claude-3-5-haiku-20241022、deepseek r1都支持,使用标准的OpenAI接口协议访问280+模型,不限时间、按量计费、极速对话、明细透明。

模型清单如下,点击可查看:

四、如何计费?

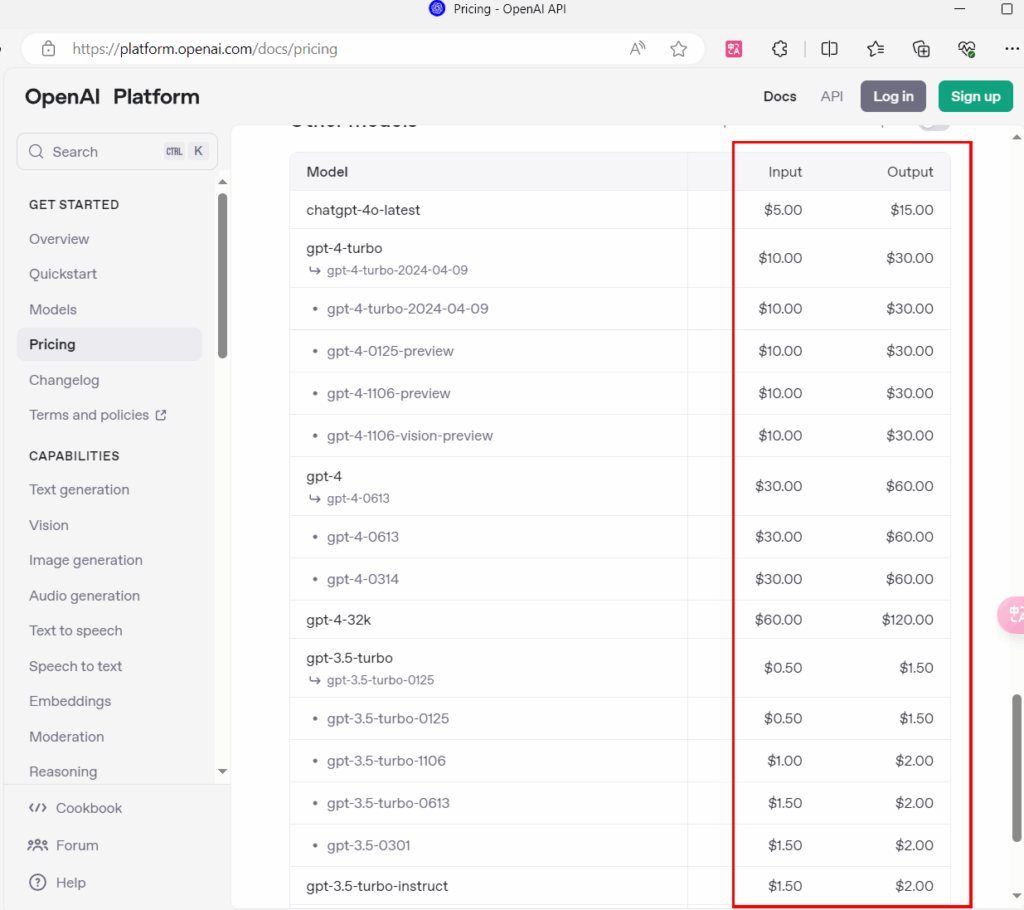

转发和官方计费一样,以下是官方文档模型提示&补全计费价格。

各大平台的AI模型收费基本都是以token为单位的,用多少收多少钱,1k tokens大概是750个英文单词,500个中文汉字,输入和输出都计费。详细模型价格查阅上面的模型清单。

五、软件教程合集

前言(重要)

模型兼容

我们的API,完全兼容OpenAI接口协议,支持无缝对接各种支持OpenAI接口的应用。

注意: 所有聊天模型(包括非OpenAI模型)都支持OpenAI官方库,请求url和格式请都遵循OpenAI的请求方式。

参考:OpenAI官方开发文档

身份认证

所有 API 请求都应在 HTTP Header 请求头中包含您的API密钥(令牌KEY)Authorization 如下所示:

在 Header 添加参数 Authorization,其值为在 Bearer 之后拼接 Token

Authorization: Bearer YOUR_API_KEY

示例:

Authorization: Bearer ********************- 程序API调用

Python 示例代码(聊天通用)

import requests

import json

url = "https://api.gpt.ge/v1/chat/completions"

payload = json.dumps({

"model": "gpt-4o",

"messages": [

{

"role": "user",

"content": "晚上好"

}

],

"max_tokens": 1688,

"temperature": 0.5,

"stream": False

})

headers = {

'Authorization': 'Bearer sk-xxxx',

'Content-Type': 'application/json'

}

response = requests.request("POST", url, headers=headers, data=payload)

print(response.text)Python 示例代码(聊天补全)

import requests

import json

url = "https://api.gpt.ge/v1/completions"

payload = json.dumps({

"model": "gpt-3.5-turbo-instruct",

"temperature": 0.7,

"max_tokens": 100,

"top_p": 1,

"frequency_penalty": 0,

"presence_penalty": 0,

"prompt": "天气非常好",

"logprobs": 1

})

headers = {

'Authorization': 'Bearer sk-xxxx',

'Content-Type': 'application/json'

}

response = requests.request("POST", url, headers=headers, data=payload)

print(response.text)- Cherry studio

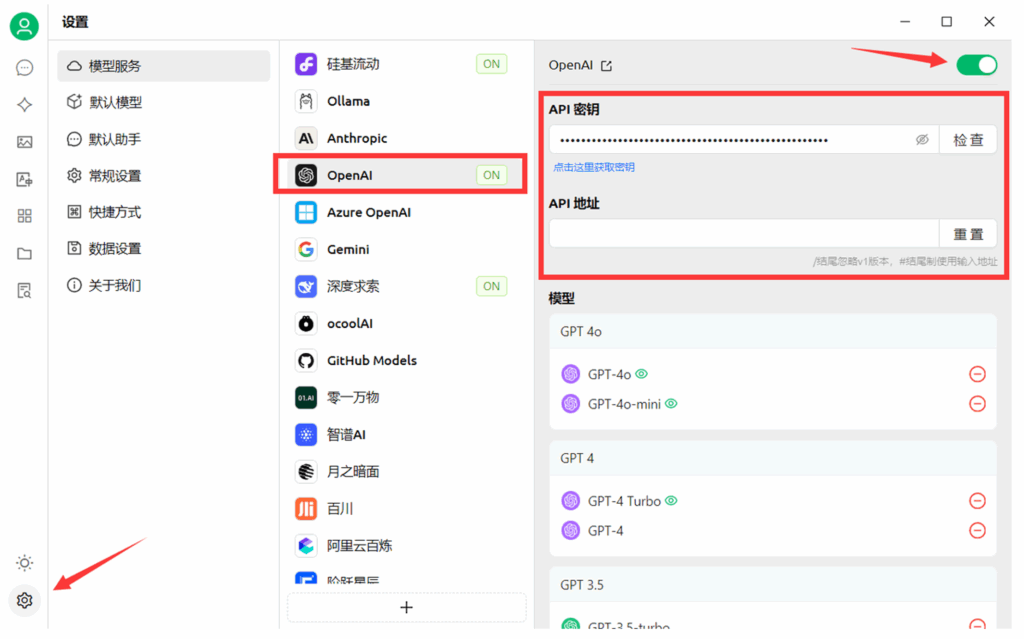

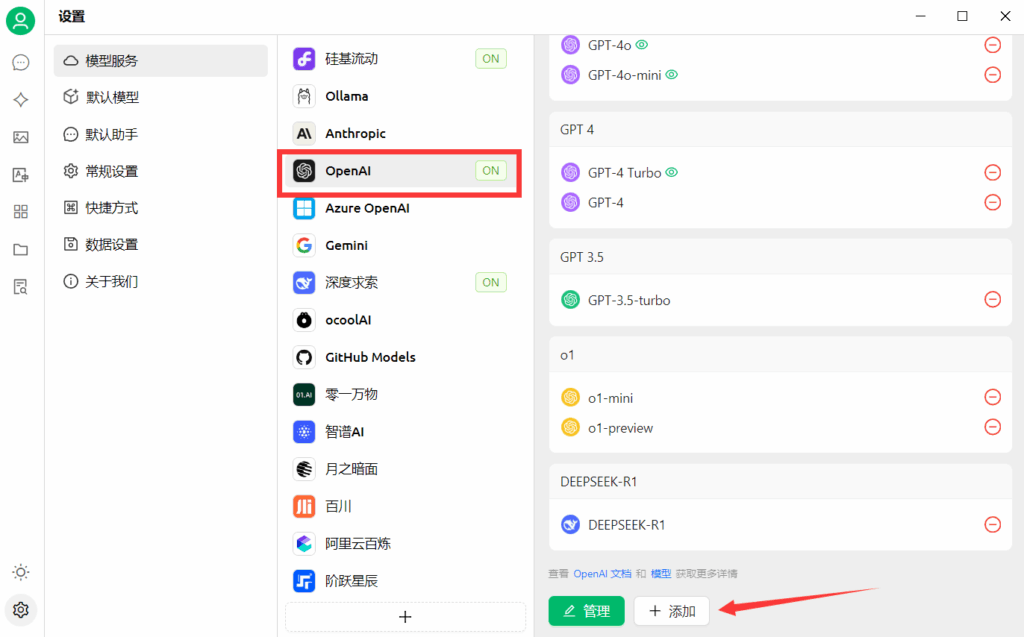

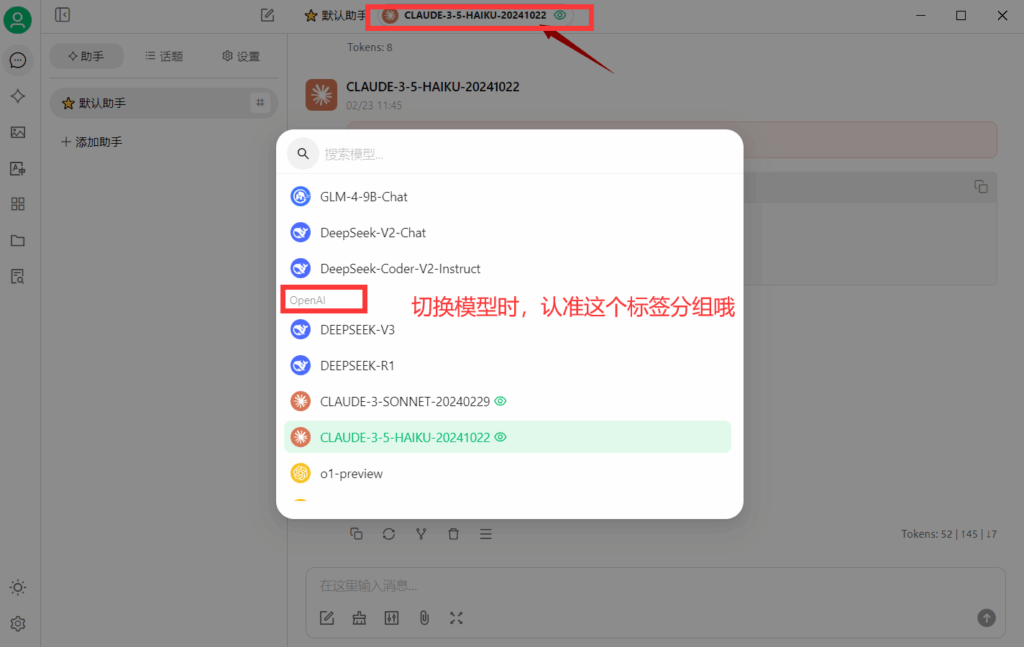

1.左下角设置→OpenAI(因为我们服务器走的是open依赖库)→填写key和对应地址

注意,地址末尾的斜杠不要有,要和下图中的地址一模一样才行

- Cursor

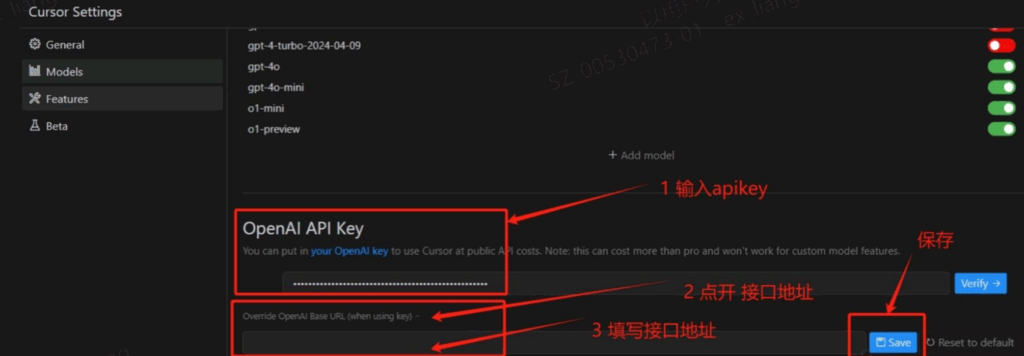

打开配置->填写apikey 和 接口地址 (填 https://api.vveai.com/v1 末尾不留斜杠)

步骤1:配置填写,如图:

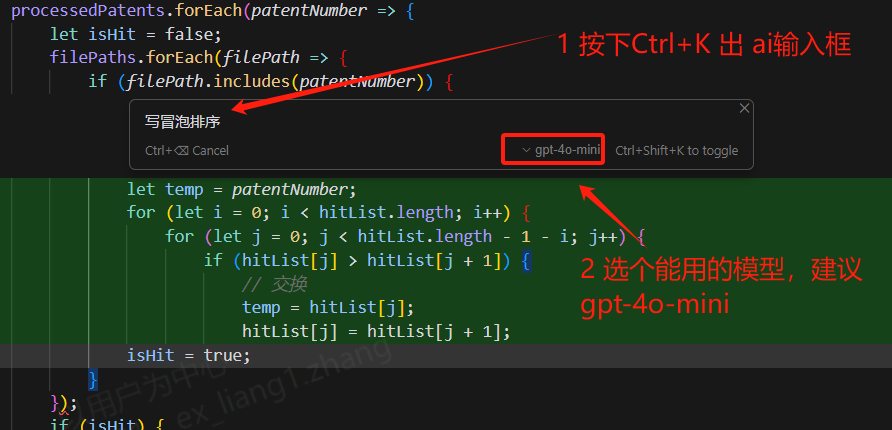

步骤2:按下 Ctrl + K 弹出ai输入框 ,

注意添加的模型名字为:

- deepseek-r1

- deepseek-r1-2025-01-20

- deepseek-reasoner

- deepseek-v3

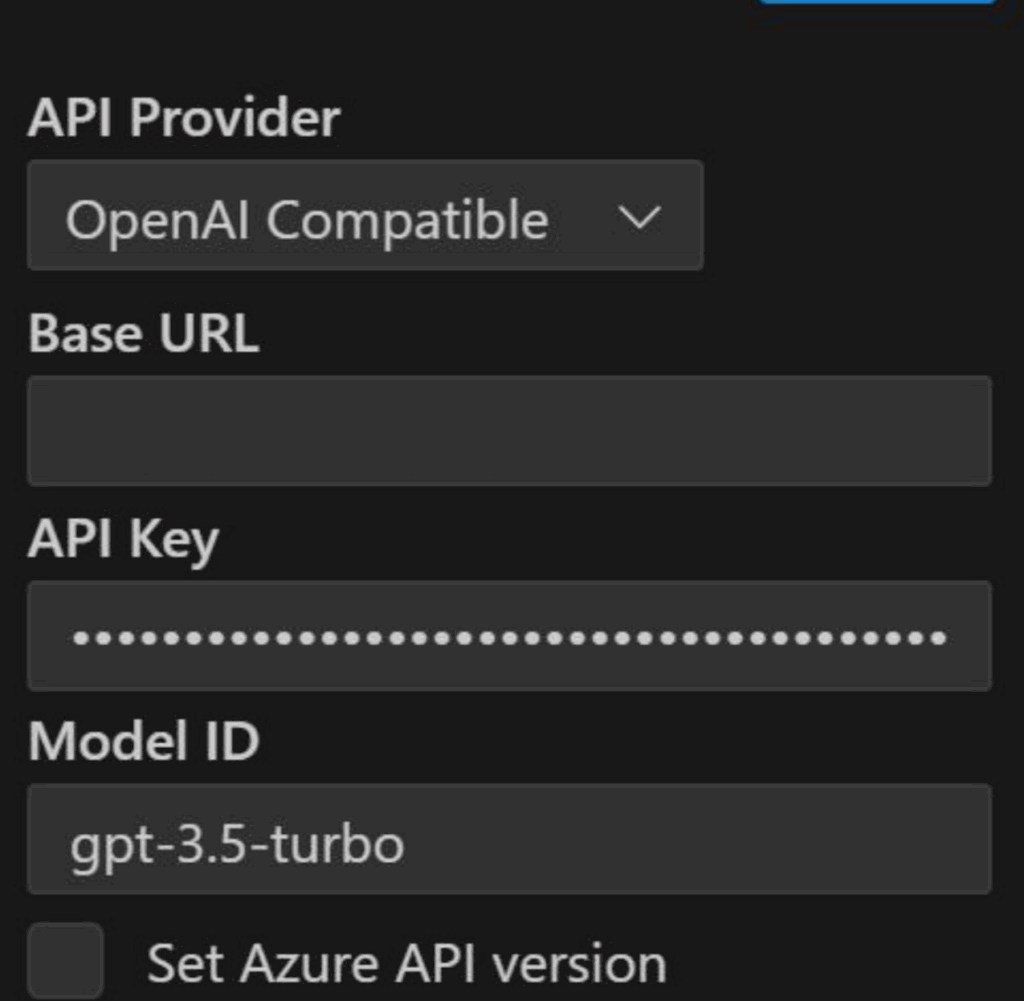

- VScode

插件选择cline

API提供商要选openai compatible

Base URL是 https://api.vveai.com/v1

模型名字写deepseek-r1

deepseek-v3任意选一个

- Open WebUI

- 点击右上角的设置图标

- 选择 “API Endpoints”

- 添加新的 API 配置:

- Base URL: https://api.vveai.com/v1

- API Key: 填入你的 API易 密钥

- 选择 OpenAI 兼容模式

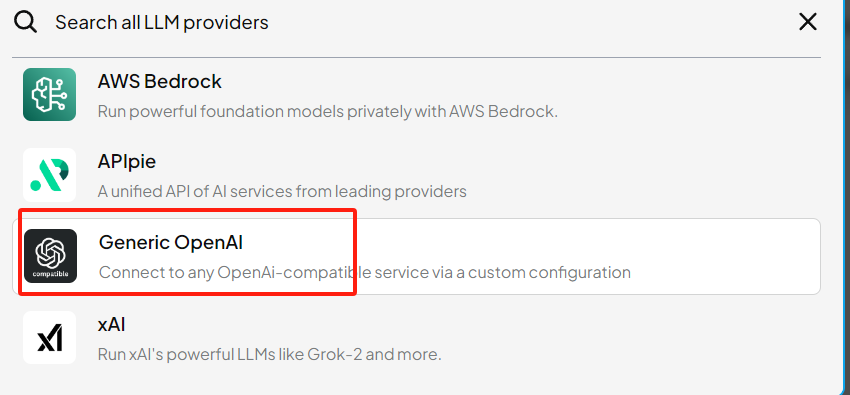

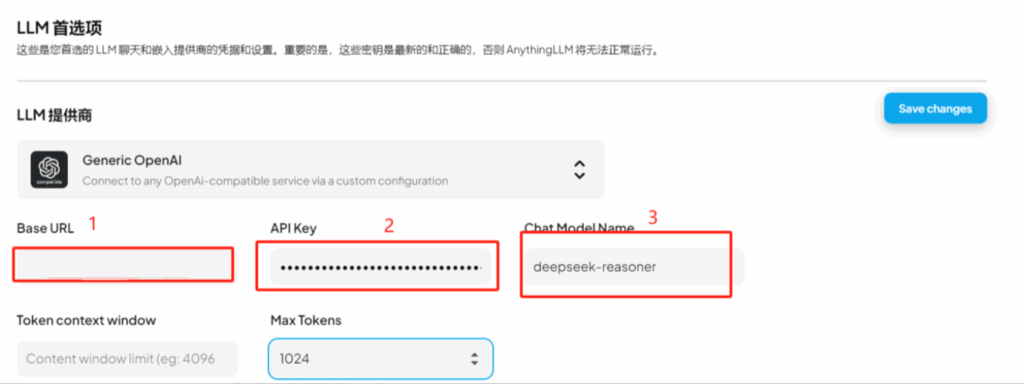

- Anything LLM

API提供商

选这个兼容模式的OpenAI

配置改图片中的三个地方

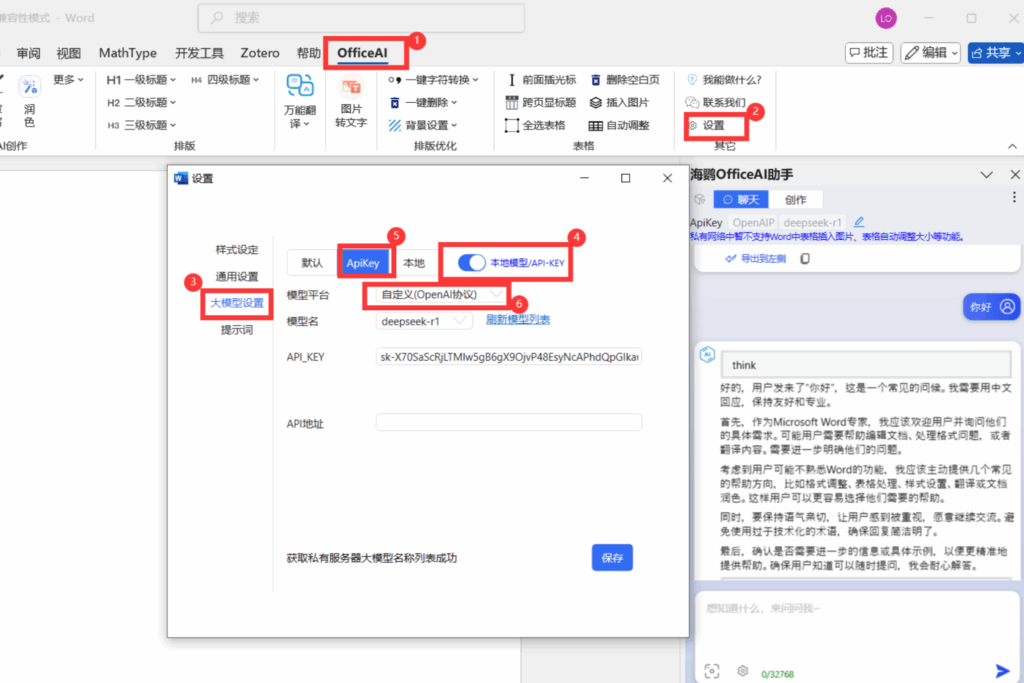

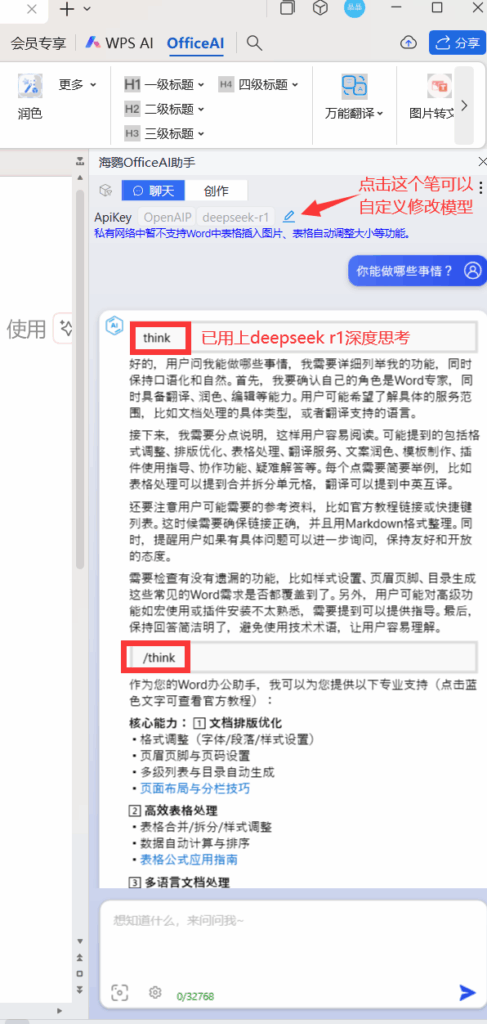

- WPS & word

在浏览器搜索office-ai.cn 下载插件

下载安装后,打开wps/word可以看到插件

点大模型设置→自定义(openai协议)→填写key→填写API地址

注意必须和红框里面格式一样才行

特别是API地址里面 https://api.vveai.com ,末尾不能有斜杠

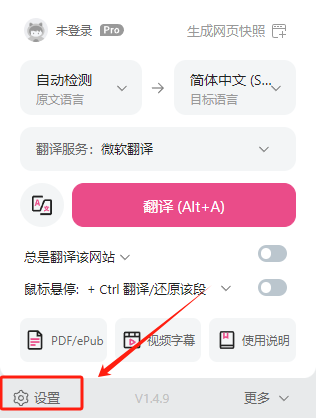

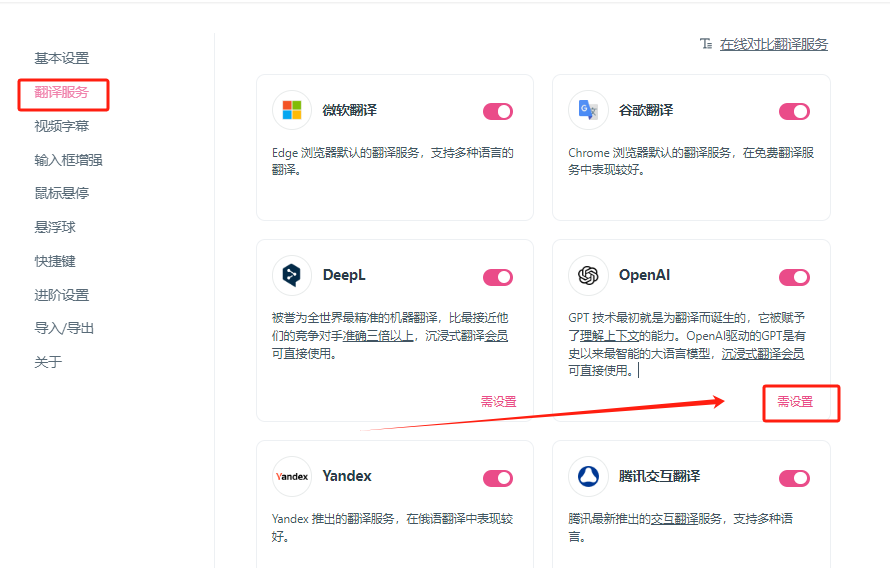

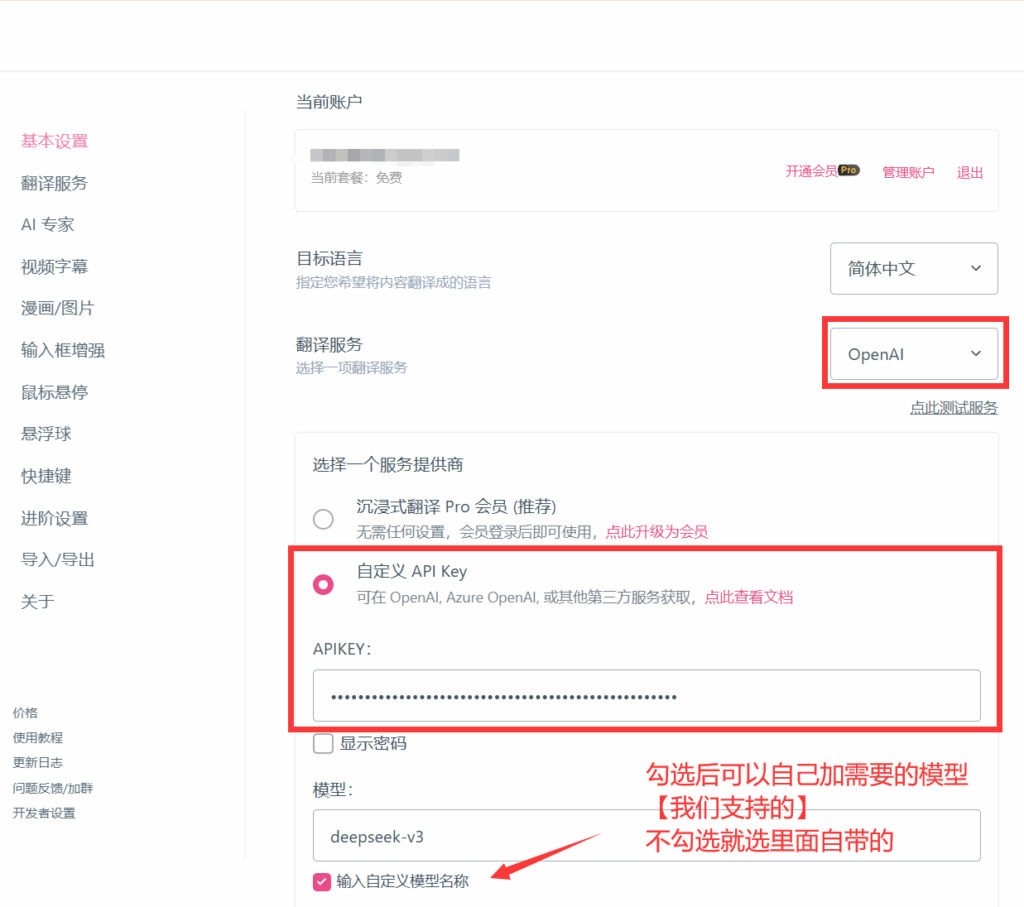

- 沉浸式翻译immersive translate配置

项目地址:https://immersivetranslate.com/

- 安装完插件后,点击设置

- 选择翻译服务,在OpenAI 下点击 需设置

- 选择自定义API Key,配置apikey 和自定义api接口地址

在自定义API接口地址中输入:https://api.vveai.com

- LangChain

LangChain是一个简化使用大型语言模型的应用框架,很多朋友都是基于LangChain做的AI大语言模型开发。

Python使用LangChain需要安装langchain和openai包,请先安装对应的库。

其中openai_api_key就是生成的令牌Key,openai_api_base是中转接口地址。

from langchain.chat_models import ChatOpenAI

llm = ChatOpenAI(

model='gpt-3.5-turbo',

openai_api_base="https://api.vveai.com/v1",

openai_api_key="sk-xxxx",

)

res = llm.predict("Who are you")

print(res)

发表回复